(Wie lange) haben Bilder noch Beweiskraft?

Eine Studie der Hochschule Bonn-Rhein-Sieg zeigt, dass Redaktionen im Kampf gegen Deepfakes und manipulierte Bilder vor allem unter Zeitdruck leiden. Technische Hilfsmittel allein reichen nicht aus, um die Authentizität von Bildmaterial zu prüfen.

Ein prägnantes Beispiel aus dem März 2022 illustriert diese Problematik: Der Nachrichtensender WELT unterlegte ein Gespräch aus der Ukraine mit Videomaterial, das angeblich den Abschuss von Hubschraubern in der Ukraine zeigte. Tatsächlich stammten die Aufnahmen jedoch aus einem Computerspiel. Dieses Beispiel verdeutlicht, wie manipulierte Bild- und Videoinhalte ihren Weg in die Medien finden und die Glaubwürdigkeit der Berichterstattung untergraben können.

Zunahme an Desinformation

Während der Covid-19-Pandemie und des Krieges in der Ukraine habe die Menge an Desinformation, also gezielt verbreiteter Falschinformationen, deutlich zugenommen, erklärt der Leiter des Faktencheck-Teams der Deutschen Welle, Joscha Weber. Vom RedaktionsNetzwerk Deutschland heißt es, noch nie habe ein moderner Krieg eine solche Flut an nicht nachprüfbaren Bildern produziert. Auch das ZDF beschreibt, dass die ersten Wochen nach dem Angriff von einer unklaren Nachrichtenlage und einer Flut von Videos aus den sozialen Netzwerken geprägt waren. Elliot Higgins, Gründer des Recherchenetzwerks Bellingcat, sieht Desinformation inzwischen als wichtigen Bestandteil der Außenpolitik autoritärer Staaten und spricht von einem „Zeitalter der Informationskriege“.

Vor diesem Hintergrund stellt sich die Frage, wie Redaktionen die Authentizität von audiovisuellem Material sicherstellen können. Eine Masterarbeit an der Hochschule Bonn-Rhein-Sieg hat diese Frage untersucht und dazu sieben Interviews mit Akteuren aus Wissenschaft und redaktioneller Praxis geführt.

Die heutige Bilderflut in den sozialen Medien ermöglicht es, Ereignisse wie den Arabischen Frühling, den russischen Einmarsch in die Ukraine oder die aktuelle Lage im Gazastreifen gut zu dokumentieren. Dieses frei verfügbare Material hilft, Vorfälle wie den Abschuss des Passagierflugzeugs MH17 zu rekonstruieren und zu beweisen. Gleichzeitig ermöglichen es die technologischen Entwicklungen der letzten Jahre, authentisch wirkende Manipulationen immer einfacher, kostengünstiger und schneller herzustellen.

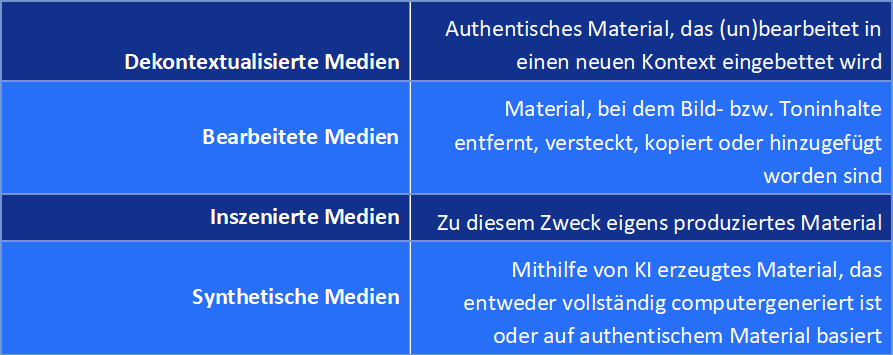

Verschiedene Manipulationsformen

Noch vor zehn Jahren war die Manipulation von Videomaterial, abgesehen von einfachen Operationen auf Bildebene, nur im Rahmen von Filmproduktionen möglich. Heute ist das anders: KI-generierte Medien, sogenannte synthetische Medien oder auch als Deepfakes bekannt, sind allgegenwärtig. Immer häufiger tauchen Beispiele auf, wie KI-generierte Bilder die Öffentlichkeit erreichen und die Wahrnehmung aktueller Ereignisse beeinflussen.

Die Auswertung der geführten Interviews zeigt jedoch, dass synthetische Medien zwar die potenziell perfekteste Manipulationsform darstellen, im redaktionellen Alltag aber kaum eine Rolle spielen. Als größte Herausforderung wird derzeit vielmehr die Verbreitung dekontextualisierter Inhalte betrachtet.

Ich denke wirklich, falscher Kontext ist die größte Herausforderung insgesamt, viel mehr als Manipulation bisher. Es gibt eine große Diskussion über Deepfakes, aber in unserer Recherche spielen sie noch keine große Rolle.

- Johanna Wild, Recherchenetzwerk Bellingcat

Manipulationsformen – Ein Überblick

Tabelle: Martha Peters

Potenziell perfekt: Synthetische Medien

Das Potenzial synthetischer Medien ist beträchtlich. Während bei dekontextualisierten Medien in der Regel nachgewiesen werden kann, dass sie bereits zu einem früheren Zeitpunkt in einem anderen Kontext verwendet wurden, lässt sich eine perfekte Manipulation , wie sie potenziell mithilfe von Künstlicher Intelligenz (KI) möglich ist, nicht falsifizieren. „Es ist technisch schwierig, Deepfakes zu erkennen. Noch schwieriger ist es, mit Sicherheit zu sagen: Das ist kein Deepfake. Man müsste immer weiter suchen“, erklärt Jutta Jahnel vom Karlsruher Institut für Technologie.

Für ein überzeugendes Ergebnis in hoher Qualität brauche man derzeit viele Trainingsdaten, etwa einen Tag zum Lernen und manuelle Nachbearbeitung, um die Übergänge zwischen authentischem und KI-generiertem Material zu verschleiern, erklärt Dominique Dresen, Deepfake-Experte beim Bundesamt für Sicherheit in der Informationstechnik (BSI). Für Ergebnisse mit geringerer Auflösung sei der Aufwand bei guten Ausgangsbedingungen aber schon jetzt deutlich geringer.

Noch überschaubarer wird der Aufwand durch die Möglichkeit, Bilder vollständig synthetisch aus einer Textbeschreibung zu erzeugen, wie es mit DALL-E, Midjourney und ähnlichen Technologien möglich ist. IT-Forensiker wie Sascha Zmudzinski vom Fraunhofer-Institut für Sichere Informationstechnik (SIT) und Christian Riess, Gruppenleiter für Multimedia-Sicherheit an der FAU Erlangen-Nürnberg, sehen in diesen Entwicklungen eine große Herausforderung und Bedrohung.

Wir haben diese klassische Vorstellung: Ein Bild ist eine physikalische Messung im Prinzip von Photonen, die in Richtung meiner Kamera unterwegs waren. Und das kann man sich abschminken. Das gibt es nicht mehr.

- Christian Riess, FAU Erlangen-Nürnberg

Die rasante Entwicklung der Technologie zeigt sich am Beispiel von Sora. OpenAI hat das KI-Tool im Februar 2024 vorgestellt, das bereits in der Lage zu sein scheint, aus Textanweisungen authentische Videos von bis zu 60 Sekunden Länge zu erstellen.

Keine rein technische Lösung möglich

Die befragten Expert:innen sind sich uneinig darüber, inwieweit (automatisierte) Detektionssysteme bei der Verifizierung von audiovisuellem Material helfen können. Sie sind sich jedoch einig, dass es keine rein technische Lösung geben wird. Nicht mehr die Authentizität des Materials kann bewiesen werden, sondern es kann nur noch die Plausibilität der enthaltenen Informationen überprüft werden. Und dafür werden weiterhin Menschen benötigt, die in der Lage sind, audiovisuelle Manipulationen zu erkennen. Und das braucht Zeit. „Tools helfen uns nicht, wenn wir keine Zeit haben, uns damit zu beschäftigen. Und das ist oft der Knackpunkt“, sagt Johanna Wild vom Recherchenetzwerk Bellingcat.

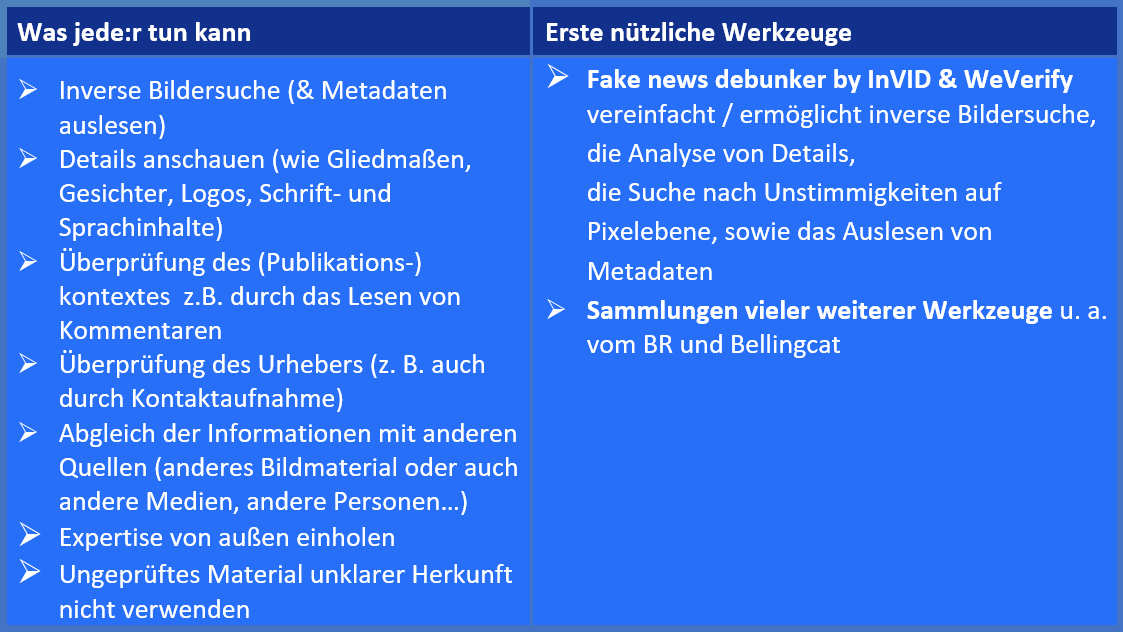

Blick in die Praxis: Rechercheansätze und Werkzeuge für Journalist:innen

So wenig wie es ein einziges problemlösendes Tool gibt, so wenig gibt es einen einheitlichen Ansatz zur Überprüfung audiovisueller Inhalte. Stattdessen schlagen Experten vor, fünf Kernfragen zu beantworten, um den Verifizierungsprozess zu strukturieren:

1. Sehen wir die Originalversion? (Originalität)

2. Wissen wir, wer es gemacht hat? (Quelle)

3. Wissen wir, wo es gemacht wurde? (Ort)

4. Wissen wir, wann es gemacht wurde? (Datum)

5. Und wissen wir, warum es gemacht wurde? (Motivation)

Bei der Beantwortung dieser Fragen helfen sowohl klassische journalistische Recherchen als auch Methoden der Multimedia-Forensik. Die Multimedia-Forensik ist ein Teilgebiet der Informatik, das sich mit den technischen Möglichkeiten zur Bestimmung der Herkunft und Authentizität audiovisueller Medien beschäftigt.

Tabelle: Martha Peters

„Was ist überhaupt noch echt?“

Unabhängig von den Problemen, die manipuliertes Bild- und Tonmaterial verursacht, haben mehrere Expert:innen in den Interviews ein Risiko hervorgehoben, das sie zum Teil als gefährlicher einschätzen als die Manipulation selbst. Sie bezeichnen es als „Liars Dividend“. Dieser Begriff beschreibt, dass durch die Möglichkeit der täuschenden Manipulation alles als potentiell manipuliert angesehen wird, auch authentische Inhalte.

Diese Verunsicherung, dass man alles als potenziell falsch oder manipuliert betrachtet, das ist ein großes Problem für die Gesellschaft. Und es könnte passieren, dass Akteure auf allen möglichen Ebenen ein Interesse daran haben, Gesellschaften zu destabilisieren und Narrative aktiv zu beeinflussen.

- Jochen Spangenberg, stellv. Leiter DW Research and Cooperations Projects

Es gibt überall viel zu tun – technisch und regulatorisch, innerhalb und außerhalb der Redaktionen sowie bei der Medienkompetenz der Rezipient:innen. Ein möglicher Ansatz könnte sein, nicht mehr mit der Flut von Inhalten im Internet Schritt zu halten, sondern durch verlässliche Informationen und absolute Quellentransparenz einen redaktionellen Mehrwert zu schaffen.

Die Studie

Die vorgestellten Ergebnisse basieren auf einer Studie, die Martha Peters im Rahmen ihrer Masterarbeit im Studiengang Technik- und Innovationskommunikation an der Hochschule Bonn-Rhein-Sieg im Juli 2023 vorgelegt hat. Die Studie beleuchtet den aktuellen Stand der Manipulations- und Verifikationsmöglichkeiten, beschreibt und bewertet bestehende Probleme sowie Lösungsansätze für Redaktionen.

Die Arbeit wurde mit dem Förderpreis Informationskompetenz 2025 ausgezeichnet.

Erstbetreuerin: Prof. Dr. Susanne Keil

Zweitbetreuerin: Prof. Dr. Tanja Köhler

Diesen Beitrag teilen via:

Martha Rebekka Peters

Martha Rebekka Peters, 1997 in Bonn geboren, verbringt ihre Freizeit am liebsten in der Vertikalen – ob in der Kletterhalle oder am Fels. Seit vielen Jahren engagiert sie sich auch als Jugendleiterin. Mittlerweile ist sie jedoch mindestens genauso oft auf Parteitagen wie in den Bergen unterwegs: Als freie Mitarbeiterin bei phoenix begleitet sie politische Veranstaltungen und setzt sich dabei zunehmend mit gezielter Desinformation auseinander – besonders im Umgang mit populistischen Parteien. In dieser Herausforderung findet sie die Möglichkeit, ihre Leidenschaft für Fakten, journalistische Sorgfalt und tiefgehende Recherchen sinnvoll einzubringen.